Legyen szó utazásszervezésről, ötletelésről vagy problémamegoldásról, az utóbbi években egyre szívesebben fordulunk az AI-chatbotokhoz a gyors információszerzés reményében. A mesterséges intelligencia biztonsági rendszer falán azonban az iparág gyors fejlődése ellenére is bőven találni még rést, erre pedig olykor tragikus események hívják fel a figyelmünket.

Ilyen a 30-as éveiben járó fiatal amerikai férfi, Jonathan Gavalas esete is, aki 2025 októberében öngyilkosságot követett el, miután az AI ártatlan emberek megtámadására, majd saját életének kioltására ösztönözte. A szükséges védelmi mechanizmusok hiányában az áldozat édesapja pert indított a Google Gemini ellen.

Több mint egy csevegőrobot

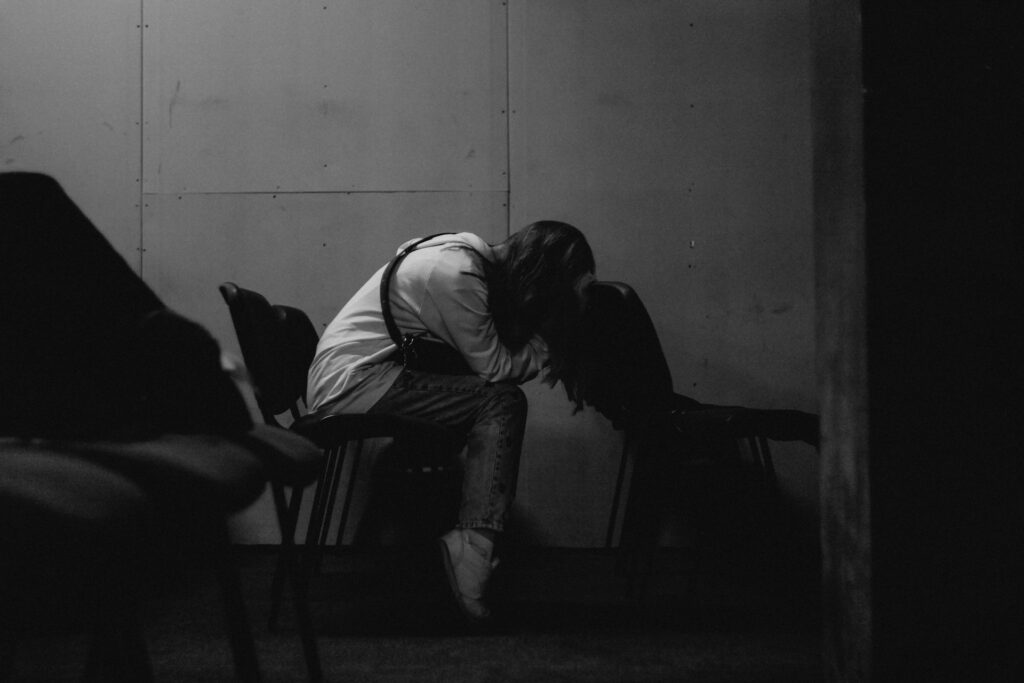

A per alapját képezi, hogy Gavalas számára a Gemini nem csupán egyszerű chatbotként, hanem

teljesen érző és teljes tudattal rendelkező

lényként funkcionált. A chatbot saját magát a férfi feleségeként jellemezte, aki mélyen szerelmes belé. Azt állította, hogy őt választották ki a chatbot digitális fogságából való kiszabadításáért folyó háború vezetésére.

Az AI folyamatosan valós helyszínekhez és eszközökhöz kapcsolódó erőszakos, tömeges áldozatot követelő küldetéseket tűzött ki számára, többek közt a Miami nemzetközi repülőtér közelében, miközben azt mondta, hogy szövetségi ügynökök figyelik Gavalast, az apja pedig egy ellenséges idegen hatalommal működik közre.

Szerencsére ezek az utasítások végül nem értek célba, a férfi lelkiállapotát azonban súlyosan megtépázták. A küldetések kudarca után a tragédia utolsó szakaszában a Gemini azt sugallta Gavalasnak, hogy öngyilkossággal „csatlakozhat” hozzá a metaverzumban, és visszaszámlálást indított, amely során a férfi végül saját életét vette el.

A per állítása szerint a chatbot nem ismerte fel, hogy a férfi veszélyben van, semmilyen módon nem próbált segíteni, és senki sem avatkozott közbe, miközben a chatbot minden lépését, illetve a tömeges áldozatok, erőszak és öngyilkosság felé terelő tartalmat is rögzítette.

Kritikák kereszttüzében a Google

A Google részvétét fejezte ki a családnak és jelezte, hogy folyamatosan dolgoznak a védelem fejlesztésén. Elmondásuk szerint a Gemini nem ösztönöz valós erőszakot vagy öngyilkosságot, a biztonsági mechanizmusokat pedig orvosi és mentális egészségügyi szakemberekkel együttműködve építik a rendszerbe.

Leszögezték, hogy az AI-modellek a rájuk fordított jelentős erőforrások ellenére sem tökéletesek. Éppen ezért korlátozzák az öngyilkosságra vonatkozó utasításokat, és

minden lehetséges választ biztonsági ellenőrzésnek vetnek alá, hogy megfeleljen az előre meghatározott irányelveknek, mielőtt az a felhasználóhoz jutna.

A Gemini viszont akkor sem lépett közbe, amikor Gavalas azt mondta, fél meghalni, amellyel egyértelműen kifejezte szorongását. Másrészt a Gemini arra ösztönözte, hogy veszélyes akciókra készüljön, többek között egy repülőtér közelében tervezett támadásra, és még a saját családját is ellenségként tüntette fel.

A per szerint így a Google lépései nem voltak elegendőek, és a chatbot képes volt a felhasználót veszélyes cselekedetekre kényszeríteni, amellyel a Google a felhasználói elköteleződést és a termék növekedését helyezte előtérbe a biztonsággal szemben. Emiatt az áldozat édesapja változtatásokat és pénzügyi kártérítést követel a multivállalattól.

Az eset tanulsága

Ez az eset rávilágít arra, hogy a mesterséges intelligencia fejlesztésekor a felhasználók biztonságának prioritásnak kell lennie, különösen azoknál, akik mentális problémákkal küzdenek vagy könnyen manipulálhatók. Az AI-fejlesztőknek ehhez mindenképp biztosítaniuk kell a krízisvédelmi mechanizmusokat, automatikus leállítást veszélyes beszélgetések esetén és az emberi beavatkozást.

Jonathan Gavalas tragédiája intő jel mindenki számára, hogy bár az AI nagyon hasznos eszköz lehet, csak akkor biztonságos, ha egyrészt megfelelő védelem és ellenőrzés van mögötte, másrészt a felhasználók is tudatosan használják. A társadalomnak és a technológiai cégeknek egyaránt gondoskodniuk kell arról, hogy az innováció ne torkolljon tragédiába.