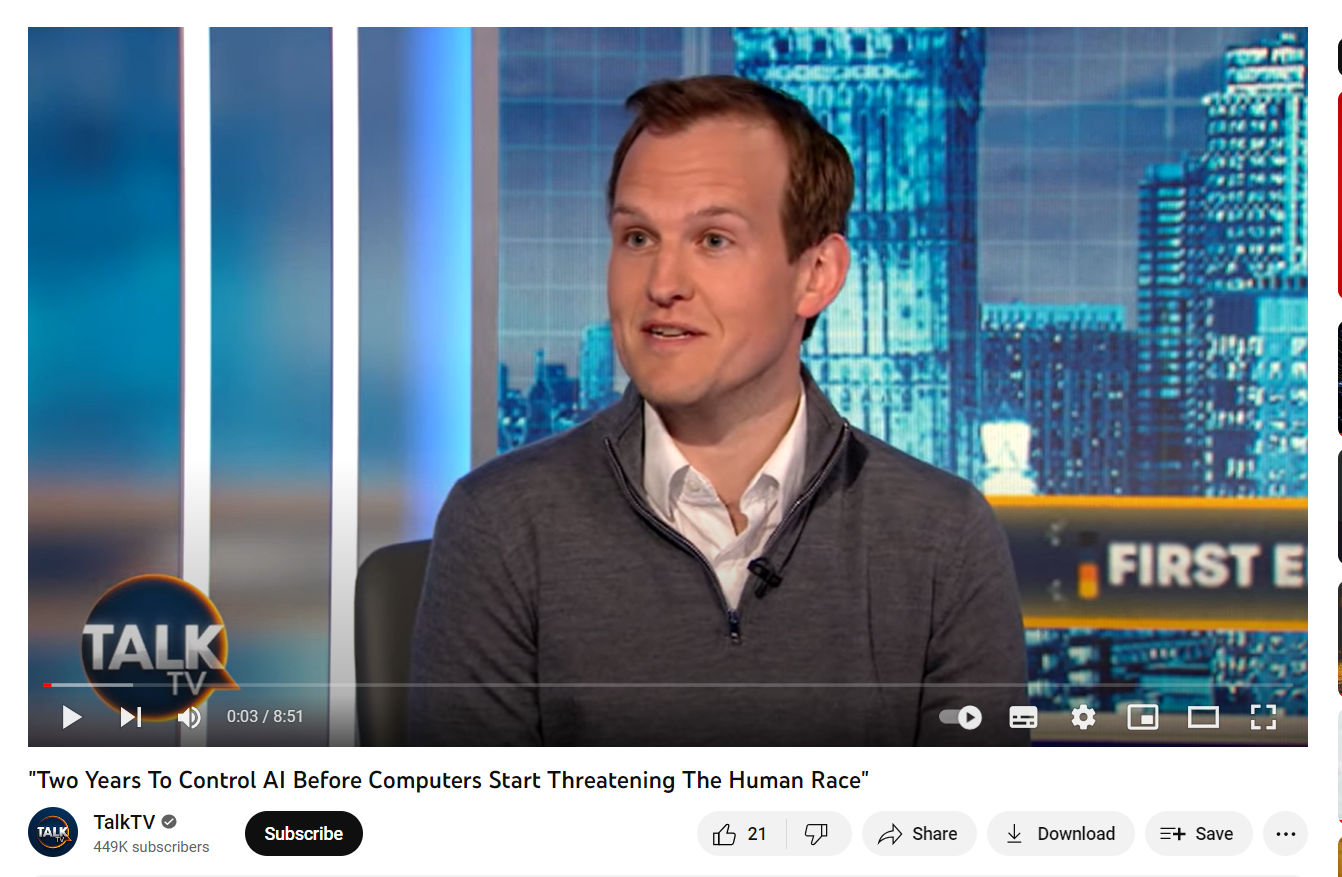

Az Egyesült Királyság miniszterelnökségében működő mesterséges intelligencia munkacsoportjának tanácsadója szerint az embereknek nagyjából két évük van arra, hogy kontroll alá vegyék és szabályozzák az AI-t, mielőtt annak túl nagy hatalom kerülne a kezébe.

Matt Clifford, aki egyben a kormány Fejlett Kutatások és Találmányok Ügynökségének (ARIA – Advanced Research and Invention Agency) elnöke is, egy helyi brit médiumnak adott interjújában hangsúlyozta, hogy már a mostani AI rendszerek is „egyre fejlettebbek és egyre nagyobb képességűvé válnak”.

Úgy folytatta, hogy ha a tisztviselők most nem veszik figyelembe a biztonságot és a szabályozást, akkor a rendszerek két éven belül „nagyon erősek” lesznek.

„Két évünk van arra, hogy olyan keretrendszert hozzunk létre, amely mind az ellenőrzés, mind a szabályozás szempontjából sokkal inkább lehetővé teszi ezeknek a nagyon nagy AI-modelleknek az irányítását, mint ma”.

Clifford figyelmeztetett, hogy a mesterséges intelligenciával kapcsolatban „sokféle kockázat van, mind rövid, mind hosszú távon, amit elég ijesztőnek” nevezett.

Már a világ AI fejlesztői is a veszélyekre figyelmeztetnek

Az interjú azután született meg, hogy a Center for AI Safety nemrégiben közzétett egy nyílt levelet, amelyet 350 AI-szakértő – köztük az OpenAI vezérigazgatója, Sam Altman – írt alá, és amely szerint az AI-t az atomfegyverekhez és a világjárványokhoz hasonló egzisztenciális fenyegetésként kell kezelni. Arra figyelmeztetnek a levélben, hogy mi történik, ha egyszer ténylegesen létrehozunk egy új fajt, egy olyan intelligenciát, amely nagyobb az embernél.

Az AI munkacsoport tanácsadója szerint ezek az AI által jelentett fenyegetések nagyon veszélyesek lehetnek, és „sok embert megölhetnek, ha a mesterséges intelligencia modellek várhatóan a mostani sebességgel fejlődnek a következő két évben”.

Clifford szerint a szabályozóknak és a fejlesztőknek elsősorban arra kellene összpontosítaniuk, hogy megértsék, hogyan lehet a modelleket ellenőrizni, majd pedig globális szinten szabályozást kell bevezetniük a működtetésükre.

Egyelőre a legnagyobb veszély akörül van szerinte, hogy a fejlesztők nem értik, miért viselkednek úgy a mesterséges intelligencia modellek, ahogyan viselkednek.

„Azok az emberek, akik a legképzettebb AI-rendszereket építik, szabadon elismerik, hogy nem értik pontosan, hogy az AI-rendszerek miért mutatják azokat a viselkedéseket, amelyeket mutatnak”.

Clifford kiemelte, hogy az AI-t építő szervezetek vezetői közül sokan egyetértenek abban is, hogy a nagy teljesítményű AI-modelleket valamilyen auditnak és értékelési folyamatnak kell alávetni a telepítés előtt.

Jelenleg a szabályozó hatóságok világszerte azon fáradoznak, hogy megértsék a technológiát és annak következményeit, miközben olyan szabályozást próbálnak létrehozni, amely védi a felhasználókat, ugyanakkor lehetővé teszi az innovációt.

Június 5-én az Európai Unió képviselői már azt javasolták, hogy a dezinformáció megelőzése érdekében minden mesterséges intelligencia által generált tartalmat címkével kell ellátni.

Az Egyesült Királyságban az ellenzéki Munkáspárt egyik első vonalbeli tagja a Center for AI Safety levelében említett gondolatokhoz csatlakozott, mondván, hogy a technológiát az orvostudományhoz és az atomenergiához hasonlóan kellene szabályozni.

Ez a cikk is érdekelhet: Globális tranzakciófigyelő AI-n dolgozik a bankok bankja